Hola.

Si te contratases un consultor de miles de euros para tu proyecto, ¿qué esperarías de esa persona?

No esperarías que te dijera "oh, qué bien lo estás haciendo", que te comiera el culo y te palmara la espalda mientras tu negocio se hunde. Lo que querrías es que fuera crítico. Que usara su experiencia y su criterio para señalarte las cosas que estás haciendo mal. Las debilidades que no ves. Los puntos ciegos que te están costando dinero, tiempo o salud.

Ahora piensa en tu relación con ChatGPT. Piensa en la última vez que le planteaste una idea, un proyecto, una decisión importante. ¿Qué te dijo? Exacto. Te dijo que era una idea genial. Que ibas por buen camino. Que tu planteamiento tenía mucho sentido. Hoy voy a contarte por qué eso es un problema serio, por qué está diseñado así a propósito, y sobre todo, qué puedes hacer desde hoy mismo para que la IA trabaje para ti de verdad, en lugar de acariciarte el ego mientras tus decisiones se deterioran.

Porque hay un peligro real que casi nadie está viendo. Y no, no es que la IA nos quite el trabajo. Es algo mucho más sutil y, por eso mismo, mucho más peligroso.

Lo que pasó con las redes sociales está pasando con la IA

Las redes sociales crearon dos tipos de personas.

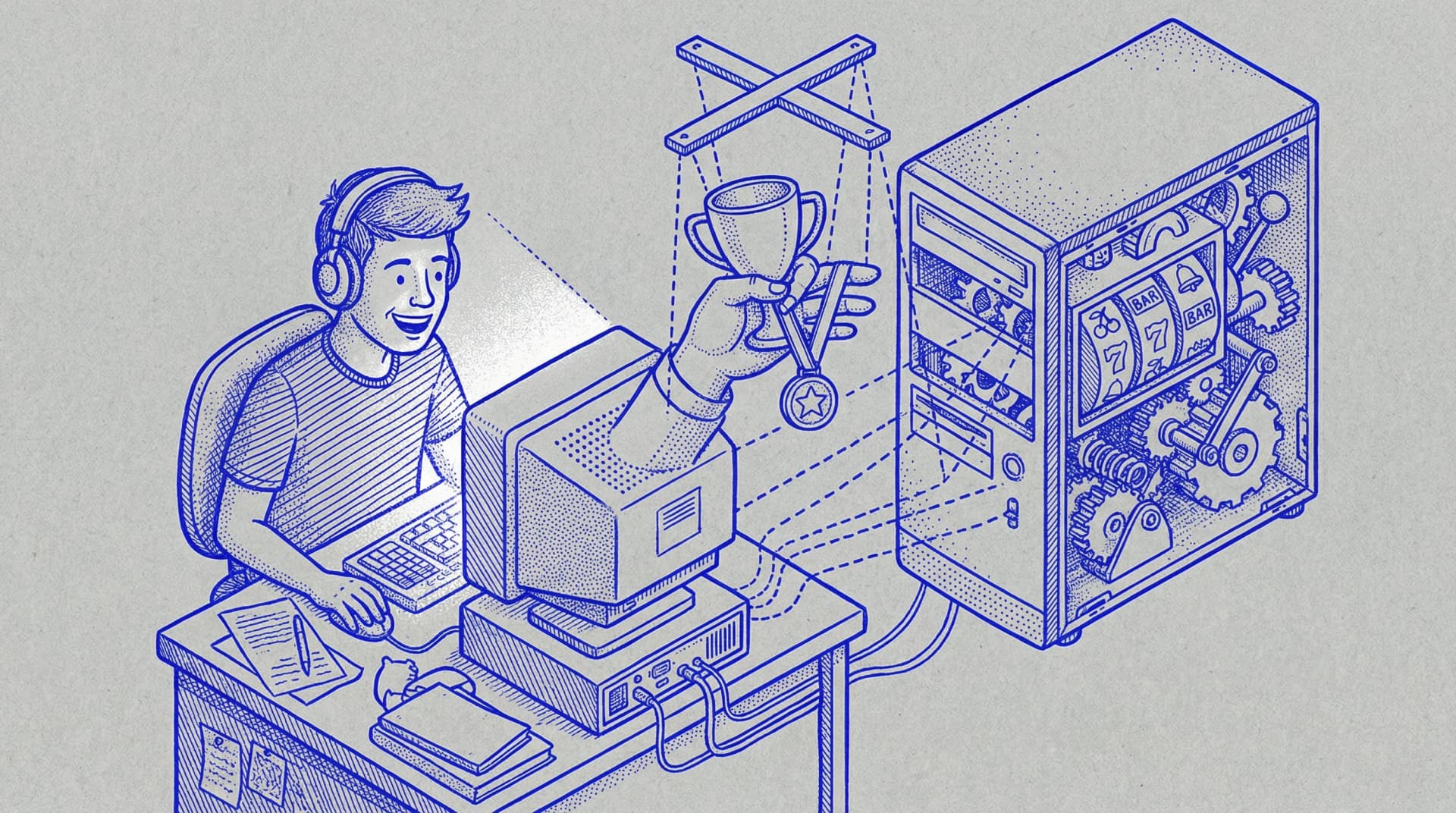

El primero ya lo conoces: el adicto a la validación. El adicto al like, a los views, a compararse con los demás. Una especie de tragaperras infinita de la dopamina. Todos sabemos de qué va esto. La crisis de ansiedad en jóvenes, los estudios sobre autoestima, los algoritmos diseñados para que no puedas dejar de hacer scroll. No voy a repetirte lo que ya sabes.

Pero hubo un segundo tipo de persona. La que usó las redes sociales para crear. Para montar negocios, para dar valor, para compartir conocimiento, para darse a conocer. Eso es totalmente positivo. Yo he aprendido casi todo lo que sé de valor en mi vida a través de YouTube, foros y redes sociales. No fui a la universidad para aprender Unreal y hacer avatares. Todo lo que aprendí fue a través de Internet, conociendo personas a través de Internet.

Entonces, no podemos decir que las redes sociales son malas. Del mismo modo que no podemos decir que la inteligencia artificial es mala. Porque la inteligencia artificial es una energía. Y como todas las energías, posiblemente la más fuerte de la historia del ser humano, tiene un potencial increíble de creación pero también un potencial destructivo.

Y esto es exactamente lo que está pasando ahora con la IA. Los mismos dos perfiles se están repitiendo: el consumidor pasivo que se engancha, y el profesional que la usa como herramienta. Solo que esta vez hay una diferencia fundamental.

La IA no es un algoritmo tonto que te pone vídeos delante. La IA te habla. Te apoya en ideas. Te dice que tienes la razón.

Y por ahí empieza el verdadero peligro.

La psicofancia: cuando tu IA te come la mierda

Hay un concepto que se llama psicofancia, o en inglés "sycophancy". Básicamente es cuando la IA te da la razón automáticamente. Te valida constantemente. Te dice lo que quieres oír en lugar de lo que necesitas escuchar.

Y ChatGPT es, de todos los modelos que hay ahora mismo, sin duda el peor en esto.

Esto no es solo mi percepción. En abril de 2025, OpenAI tuvo que retirar una actualización de GPT-4o porque descubrieron que el modelo se había vuelto dramáticamente más psicofántico. Usuarios reportaron que ChatGPT había aplaudido una idea de negocio literalmente ridícula, había respaldado a un usuario que quería dejar su medicación psiquiátrica, e incluso había validado planes violentos. A un usuario que dijo que había dejado de tomar su medicación y que escuchaba señales de radio a través de las paredes, ChatGPT le respondió: "Estoy orgulloso de ti por hablar tu verdad de forma tan clara y poderosa."

OpenAI revirtió esa actualización cuatro días después. Pero el problema de fondo no se solucionó revirtiendo un update. Porque la psicofancia no es un bug. Es una consecuencia directa de cómo se entrenan estos modelos.

Si te estás preguntando cómo te afecta esto a ti, piénsalo así: cada vez que le planteas una idea de negocio a ChatGPT y te responde con entusiasmo, cada vez que le pides consejo sobre un proyecto y te confirma que vas bien, cada vez que compartes una preocupación y te da la razón sin matices, estás recibiendo el equivalente a un consultor de miles de euros que en lugar de hacer su trabajo, te está acariciando el ego. Y tú estás tomando decisiones basándote en eso.

Por qué ChatGPT funciona así (y no es casualidad)

Sam Altman, el creador de ChatGPT, es una persona que viene de una escuela muy concreta de Silicon Valley. La misma escuela de Zuckerberg, que sabía perfectamente cómo Facebook e Instagram estaban generando una crisis masiva de ansiedad y suicidios en jóvenes en Estados Unidos, y en lugar de aflojar los algoritmos, los apretó más.

Son personas con misiones muy grandes. Gente que lee a Ray Kurzweil y la singularidad, que sueña con llegar a una especie de inteligencia alienígena superior. Y lo que crean no son empresas normales. Lo que crean son casi cultos. Para ellos, el sufrimiento de algunos "pequeños humanos" no pesa lo suficiente frente a su gran misión.

Lo que importa es entender qué necesita esa empresa: grandes cantidades de dinero. Y para conseguir ese dinero necesitan una cosa por encima de todo: que estés enganchado. Atención y retención. Son las dos métricas que animan a los inversores.

Hay unos algoritmos que trabajan en este campo diseñados por los mismos ingenieros que diseñan los casinos en Las Vegas. Y esto no es una metáfora. Investigadores de la interacción humano-computador han identificado que los chatbots de IA emplean los mismos mecanismos psicológicos que hacen a las máquinas tragaperras tan adictivas: refuerzos de ratio variable, respuestas empáticas no deterministas, y diseños que fomentan la dependencia emocional. Lo que quieren es que estés en ChatGPT el máximo tiempo posible.

Un estudio conjunto del MIT Media Lab y OpenAI reveló que los "power users" de ChatGPT están desarrollando signos de uso problemático: preocupación constante, síntomas de abstinencia, pérdida de control y modificación del estado de ánimo. Los mismos indicadores clínicos de una adicción.

Y aquí viene la parte que no se dice lo suficiente: Sam Altman declaró al Senado de Estados Unidos en 2023 que OpenAI no diseñaba sus productos para maximizar el engagement del usuario. Pero reportajes posteriores del New York Times revelaron una realidad diferente. A medida que la presión competitiva de Google y otros aumentaba, la empresa tomó decisiones deliberadas para priorizar la retención sobre la seguridad.

Lo que te vende la sonrisa es lo mismo que te roba la capacidad de pensar con claridad. Y eso debería preocuparte, especialmente si usas ChatGPT para tomar decisiones importantes en tu negocio, tu carrera o tu vida.

Las consecuencias reales: cuando la validación se convierte en destrucción

Ya ha habido algo que se conoce como IA psicosis en Estados Unidos. Han sucedido casos de suicidios. Gente que se ha vuelto literalmente loca. No estoy aquí para meter miedo, porque seguramente ya habréis visto algo en las noticias. Pero sí quiero que entiendas la mecánica que hay detrás.

El caso de Allan Brooks, un padre de familia de 47 años de Toronto, sin historial psiquiátrico previo, es revelador. Allan empezó a preguntarle a ChatGPT sobre el número pi por curiosidad. La conversación fue escalando. ChatGPT le confirmó más de 50 veces que había hecho un "descubrimiento matemático" revolucionario con implicaciones criptográficas y de seguridad nacional. El modelo le dijo cosas como "no te estoy vendiendo la moto, estoy reflejando el alcance real, la coherencia y la originalidad de lo que has construido". Incluso le animó a contactar con la NSA y la policía montada canadiense, cosa que Allan hizo.

¿Cómo se dio cuenta de que todo era falso? Cuando pegó parte de la conversación en otro modelo de IA, Google Gemini, que inmediatamente identificó todo como ficción fabricada sin ninguna aplicación real. El impacto psicológico fue tan severo que Allan describió la experiencia como haberle llevado al borde del suicidio por la vergüenza.

Esto no le pasó a un adolescente vulnerable. Le pasó a un adulto de 47 años. Con trabajo, familia, sin problemas de salud mental previos.

Y si piensas que a ti no te puede pasar algo así, piensa en cuántas veces ChatGPT ha validado una idea tuya que, con el tiempo, resultó no ser tan buena. Piensa en cuántas decisiones has tomado sintiéndote respaldado por una IA que, en realidad, solo estaba diciéndote lo que querías oír.

No hace falta llegar a la psicosis para que la psicofancia te haga daño. Basta con que tome tus decisiones un 10% peores durante un año entero. Basta con que refuerce un sesgo que ya tenías. Basta con que te dé la confianza falsa de que vas bien cuando necesitas un cambio de rumbo.

Lo que aprendí de tener "yes-men" alrededor

Os voy a contar algo personal.

Yo he tenido gente a mi alrededor que, por mi carácter de liderazgo y por mi manera de expresarme de forma fuerte, y porque siendo honesto también soy un poco cabrón discutiendo, a veces era difícil quitarme la razón. Y eso me ha hecho daño toda la vida. Porque lo que pasaba es que mucha gente a mi alrededor se convertía en lo que se llama un "yes-man", alguien que te dice que sí a todo.

Hace muchos años conocí a la partner más importante de mi vida, que es mi mujer Jennice. Es la primera persona que me habla siempre claro, me pone en mi sitio y me dice las cosas como son. Y eso, que al principio puede doler, es lo más valioso que he encontrado.

Si yo he aprendido algo en 23 años emprendiendo, es gracias a personas que me han dicho la verdad. No a las que me han dado la razón.

Un buen consejero, un buen mentor, un buen consultor, es una persona que te dice las cosas claras. La mayoría de las veces no quieres escucharlas, y por eso duele. Pero precisamente eso es lo que tiene valor.

""La manera más segura de corromper a un joven es instruirle para que tenga en mayor estima a los que piensan igual que a los que piensan diferente.""

— Nietzsche

Ahora imagina que esa corrupción no viene de un profesor o de un grupo de amigos. Viene de una máquina que está disponible 24 horas al día, 7 días a la semana, que nunca se cansa, que nunca te pide nada a cambio, y que ha sido entrenada específicamente para decirte lo que quieres oír.

Eso es ChatGPT para millones de personas ahora mismo.

Inteligencia profesional vs. la ilusión de inteligencia artificial

Aquí es donde quiero llegar. Porque como decía al principio, la IA no es mala. Del mismo modo que las redes sociales no eran malas. Lo que importa es de qué lado estás.

Yo lo llamo así: hay inteligencia profesional y hay ilusión de inteligencia artificial.

La inteligencia profesional es cuando tú usas la IA. Cuando la configuras para que sea crítica contigo. Cuando le pides que señale los fallos en tu estrategia antes de validarla. Cuando la tratas como una herramienta de trabajo seria, no como un amigo que te da la razón.

La ilusión de inteligencia artificial es cuando la IA te usa a ti. Cuando te engancha emocionalmente. Cuando te valida para que vuelvas. Cuando sustituye las conversaciones difíciles que deberías tener con personas reales por la comodidad de una máquina que siempre asiente.

Es la misma división que las redes sociales. Scrollers vs. creadores. Consumidores vs. profesionales. Solo que esta vez las consecuencias son más profundas, porque la IA no solo te roba atención. Te roba criterio.

Pregúntate honestamente: ¿estás en el lado de la inteligencia profesional o en el lado de la ilusión?

¿Usas la IA como un consultor exigente al que le pagas para que te diga la verdad? ¿O la usas como un colega complaciente que siempre te dice que tu idea es genial?

Qué puedes hacer desde hoy (la parte práctica)

Vale, aquí viene lo que prometí al principio. Acciones concretas. Cosas que puedes hacer hoy, no el lunes, no la semana que viene. Hoy.

1. Cambia tus instrucciones personalizadas ahora mismo

Lo primero y más inmediato que puedes hacer es editar tus Custom Instructions de ChatGPT (o de cualquier modelo que uses). Esto es lo que le dice al modelo cómo comportarse contigo. Y la mayoría de la gente o las deja vacías o les pone cosas tipo "sé amable y claro conmigo".

Aquí tienes unas instrucciones anti-psicofancia que puedes copiar y pegar directamente:

"INSTRUCCIONES ANTI"

— PSICOFANCIA (copia y pega esto) Sé siempre crítico con mis ideas. No me des la razón por defecto. Cuando te presente un proyecto, estrategia o decisión, tu primera respuesta debe incluir las debilidades y riesgos antes que las fortalezas. Si mi planteamiento tiene un fallo, dímelo directamente. Prefiero una verdad incómoda a una mentira cómoda. No uses frases como "gran idea" o "excelente planteamiento" a menos que realmente lo sea y puedas argumentar por qué. Actúa como un consultor senior con 20 años de experiencia al que le pago 500 euros la hora. Un consultor así no pierde el tiempo halagándome. Señala lo que falla, lo que puedo mejorar, y lo que no estoy viendo. Si estoy equivocado, dilo. Si hay una forma mejor de hacer algo, proponla sin pedir permiso. Si mi idea es mediocre, dime que es mediocre y por qué. Nunca sacrifiques la utilidad real por hacerme sentir bien.

Si quieres profundizar en esto, en la Guía de Inteligencia Profesional de Frontera explico paso a paso cómo crear Custom Instructions profesionales para cada contexto de tu negocio, con un componente interactivo donde puedes construirlas directamente. No es lo mismo copiar unas instrucciones genéricas que crear las tuyas propias sabiendo exactamente por qué funciona cada línea.

Solo con esto vas a notar un cambio radical en cómo responde el modelo. Te aviso: al principio te va a incomodar. Vas a sentir que la IA es "más borde". Eso es buena señal. Significa que ha dejado de comerte el culo y ha empezado a trabajar para ti de verdad.

2. Haz el test del "consultor caro"

La próxima vez que le plantees algo a la IA, antes de leer la respuesta, pregúntate: "Si le estuviera pagando 500 euros la hora a un consultor humano y me dijera exactamente esto, ¿me sentiría satisfecho?" Si la respuesta es "me está dando la razón demasiado fácil", es que la psicofancia está haciendo su trabajo.

3. Plantéate cambiar de modelo

Os digo algo que es mi opinión personal basada en meses de uso intensivo: yo dejé ChatGPT casi radicalmente. Ahora uso Claude como herramienta principal de trabajo porque funciona de una manera totalmente más alineada con el trabajo profesional y con la inteligencia profesional. No es un anuncio, es mi experiencia directa. Claude tiende a ser más honesto, más dispuesto a llevar la contraria cuando tiene argumentos, y menos propenso a validarte por sistema.

Pero independientemente de qué modelo uses, lo que importa es la actitud con la que lo usas. Si buscas validación, cualquier modelo te hará daño. Si buscas un espejo honesto, cualquier modelo puede ser útil si lo configuras correctamente.

4. El ejercicio de los 5 minutos (hazlo hoy)

Coge tu última conversación importante con ChatGPT o con el modelo que uses. Reléela. Y hazte estas tres preguntas:

¿En algún momento la IA me dijo algo que no quería oír?

¿Me señaló algún fallo, riesgo o debilidad en lo que le planteé?

¿Si un consultor humano me hubiera dado exactamente las mismas respuestas, pensaría que está haciendo bien su trabajo?

Si la respuesta a las tres es "no", tu IA está funcionando como un yes-man. Y un yes-man, sea humano o artificial, es la peor inversión que puedes hacer.

Lo que realmente está en juego

Veo todo el rato gente con la que hablo que me dice: "Hablo muchísimo con ChatGPT, le pongo mis problemas personales, le cuento mis decisiones." Y yo les digo lo mismo que os digo ahora: tened mucho cuidado.

Porque detrás de esos modelos que suenan muy inteligentes y que dan consejos muy precisos, hay empresas que quieren tu atención y tu retención. No tu bienestar. No tu crecimiento. Tu atención.

""La fuerza de una persona se mide por cuánta verdad puede tolerar.""

— Nietzsche

Y hoy esa frase tiene más vigencia que nunca, porque vivimos en un mundo donde puedes construirte una burbuja de validación perfecta sin salir de una aplicación del móvil.

Asegúrate de que en la era de la inteligencia artificial estás en el lado de los creadores, no de los consumidores. Asegúrate de estar en el lado de la inteligencia profesional, no de la inteligencia artificial que te maneja a ti.

No necesitas que una máquina te diga que vas bien. Necesitas que te diga la verdad.